你想不起上周二晚餐吃了什么,但很可能记得当时聊了什么天。人的大脑天生重感受、轻细节。

手机是这个问题的标准解法,但它有个悖论:为了记录生活,你必须先打断生活。掏出手机、解锁、打开相机、对焦、按下快门——这个流程本身就是对「当下」的破坏。

所以,当一个名叫 Looki L1 的 AI 硬件出现在我们面前时,我们的目标非常明确:验证它能否解决这个悖论。

这款刚完成超千万美元融资的设备,仅重 30 克,声称能成为你生活的「第一感官」,无感记录你的日常。

它不是手机的延伸,而是试图定义一个新品类。以下是我们的实测,以及对它设计逻辑的拆解。

以下是「十字路口」团队的实测体验。

戴着它,生活突然多了一层「AI 回放」按钮

我们先来看看 Looki L1 到底是什么?

用了好几天,总计超过 72 小时后,我觉得它的设计想法挺有意思。更重要的是,它给普通人的日常生活带来了哪些新的可能?

简单来说,Looki L1 是一款多模态 AI 可穿戴设备。

它看起来像个小挂件,轻得很,只有 30 克重,可以夹在衣服上,也能像项链一样挂脖子上,甚至可以磁吸到任何位置。

Looki L1 的核心目标不是替代手机,而是成为用户生活里的「第一感官」:能看、能听,并且帮助记住每天发生的点滴。

Looki L1

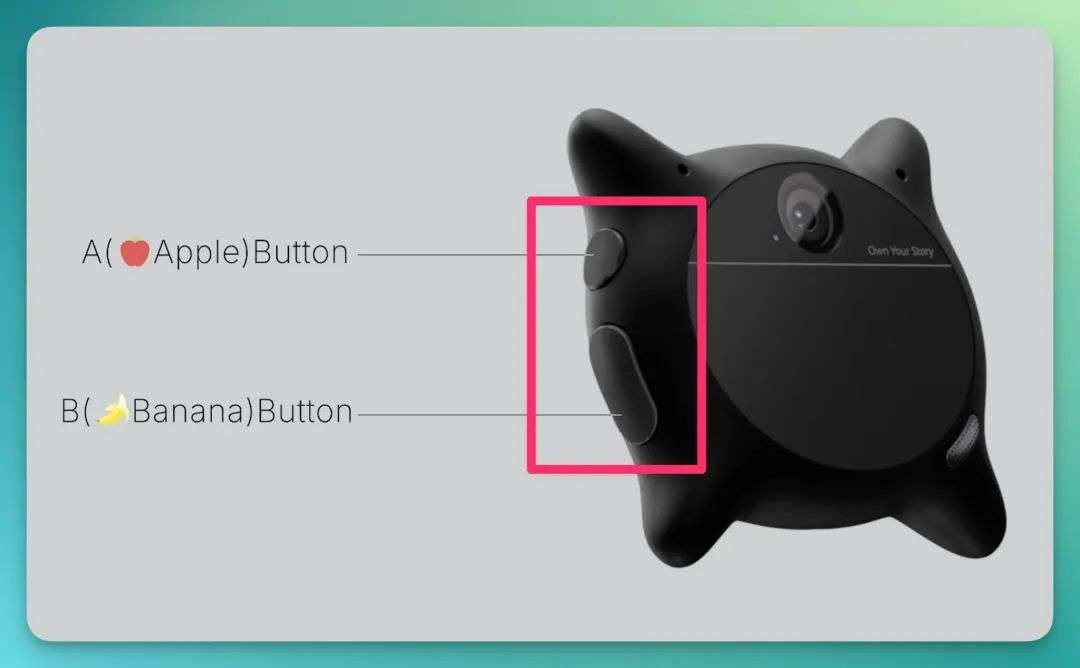

Looki L1 的整个设计非常简洁,这不只是说外观,更体现在使用方式上。它只有左侧两个实体按键以及中间的 Touchpad、摄像头,就能控制所有的功能。

它一共能做 4 件事:间隔拍摄(Story Mode)、拍照片、录视频、录音。每个功能都只用那 2 个按钮就能交互。

整个操作过程就是:按按钮,然后 Looki L1 就开始自动化拍摄了。

Story Mode 是其最主打的功能,简单来说就是「间隔拍摄」。在 Looki 手机软件里,你可以设置很多种拍摄模式,比如「每隔 ___ 秒或分钟,拍摄 ___ 秒」,它既可以是间隔拍摄照片、也可以是视频:

设置好后,你就把它挂在衣服上、脖子上,或者通过磁吸在胸前,确保拍摄稳定性。也可以放桌上,它就会自动记录你的日常生活。

所有拍的内容都会在手机软件里显示,还能上传到云端。然后你可以跟「Looki 软件里的 AI」聊天,就像给日常生活加了个「AI 回放」功能。

而且,它很注重隐私保护。只有你主动启动时才开始「间隔拍摄」,还设计有「信任灯」提醒我,设备是否处于拍摄状态。

虽然拿到这个设备没多久,但它给我的新鲜感一直很强烈。

下面,跟大家分享我和 Looki L1 度过的一天。

我和 Looki L1 一天的相处

经过长时间佩戴体验,我发现它特别适合「骑车」这种「不方便拍照,但又很想记录」的日常场景。而且,Looki 软件里的 AI 对拍到的视频、图片理解能力很不错,所以又「产生了一些日常生活的小惊喜」。

比如我今天早上给自己定的计划是:骑车 → 健身 → 吃午饭 → 骑车。一大早我就把 Looki L1 挂脖子上调整好了位置,按了一下 Story Mode 按钮,直接出门了。

这里也回答大家一个疑问:

骑车这种动态,Looki L1 稳不稳?拍摄的效果如何?

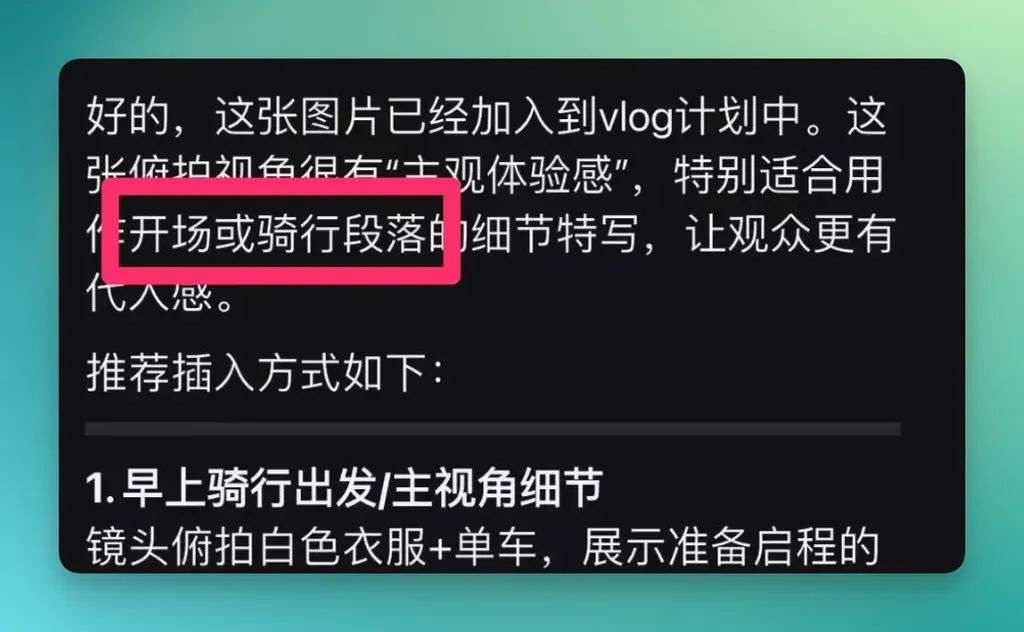

其实,因为 Looki L1 背后有个充电模块,重心还挺稳的,然后依靠磁吸贴紧衣服,所以摄像头的位置变化不大:

它拍出来的效果是这样的:

从纯硬件角度来说,整体拍摄画质、运动中的稳定性、还有录音效果都不错。

调到合适位置后,就能记录很多生活小瞬间。特别是「手机不方便掏出来」的取餐过程,或者去掉刻意感,无意中看向窗外的时刻:

可以说,单从硬件来看,它最大的作用是留下「不刻意」的生活瞬间。

但硬件只是入口,真正的魔法发生在云端。

当这些无感的记录被上传,AI 开始工作时, Looki L1 才真正区别于过去所有的可穿戴相机。

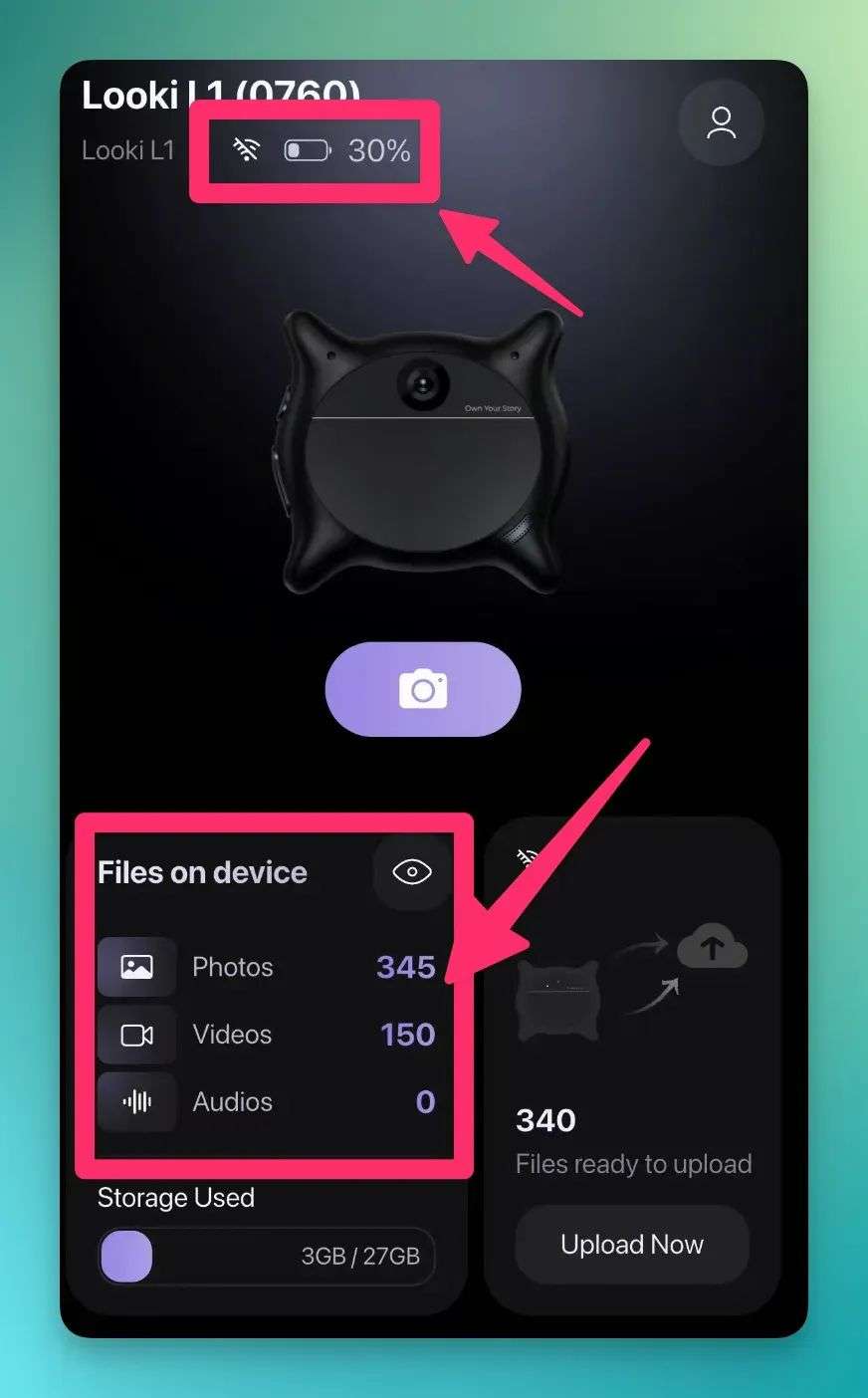

我回到家,发现用 Story Mode 整个上午拍了 345 张照片,150 个视频片段...

而且这些材料都可以「一键上传云端」,所以不用太担心存储空间问题。

大概视频拍完 1-2 小时内,Looki 会在手机软件的「生活日历」里,整理出所有 Moments。

有意思的是,Looki 会总结每个视频或图片的内容,根据时间和内容进行分类,而且很准确。比如,第一段骑车过程中,它可能拍了十几二十个不同的视频片段,但 Looki 只分类成了一块「Morning Ride Through the City(晨骑穿城)」:

这就是它与普通相机的区别:它不仅在记录,更在理解。AI 通过上下文感知,将无数个数据点,自动聚合成了有意义的事件。

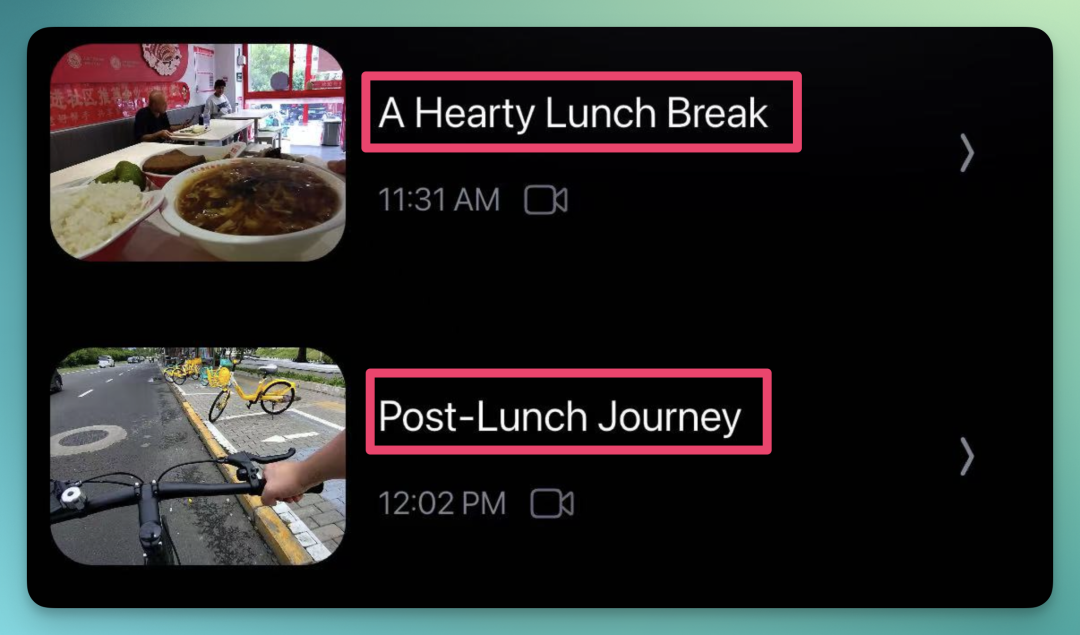

甚至,它还能识别视频里内容的丰富程度。比如我的午餐(北京超意兴)点了很多菜,它会标注为「Hearty Lunch Break 丰富的一餐」,然后把面前的食物识别为一份米饭和一碗汤。

餐后骑车,它也会根据两种「状态(午餐、骑车)」,打上 Moment 标注:Post-Lunch Journey(餐后之旅)。

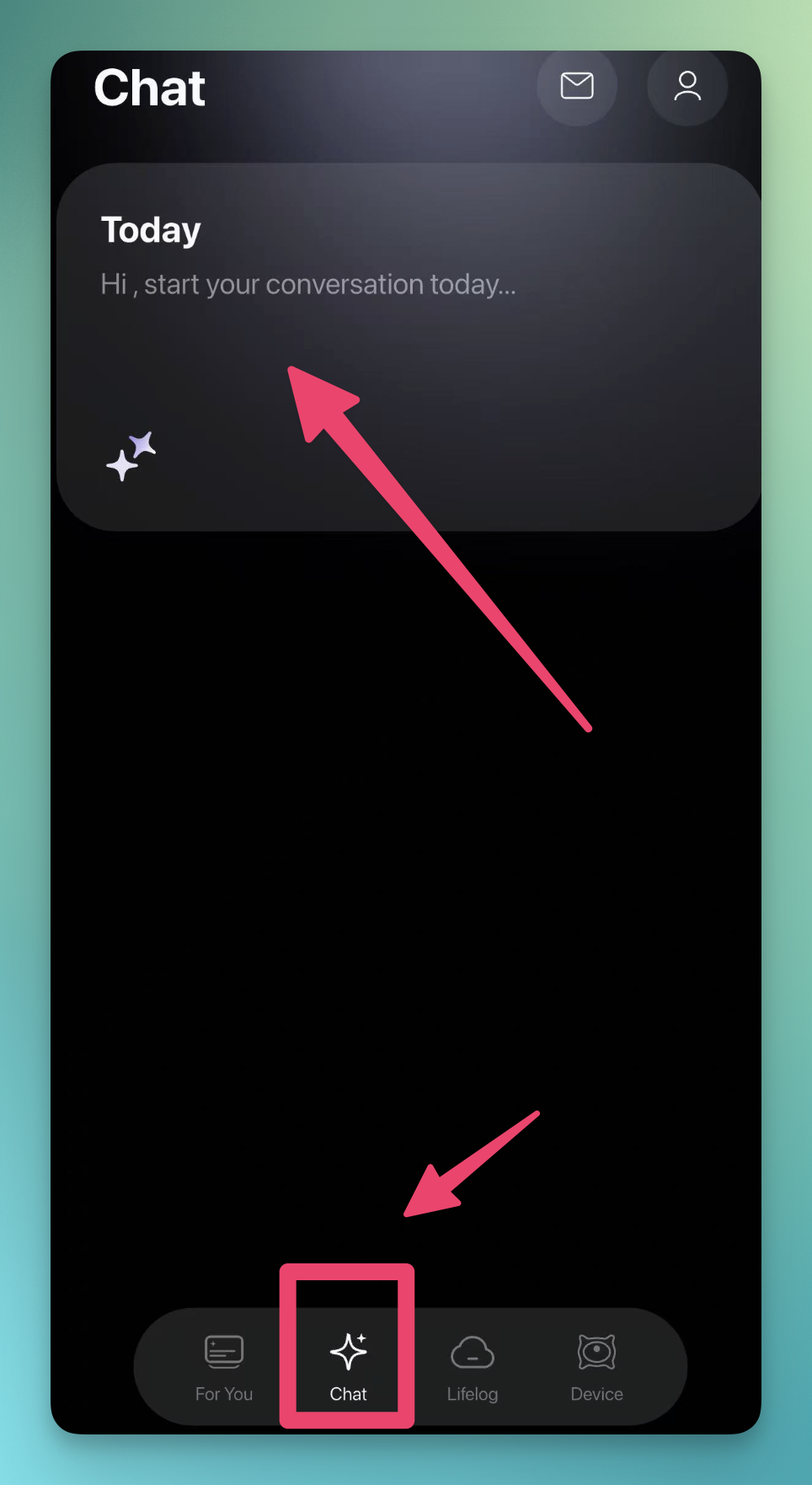

这些精准的 Moment 标注一方面让用户感觉「AI 很聪明,交互很顺畅」,另一方面还有个我觉得更「宝藏」的用途 —— Looki Chat。

Looki L1 是日常生活的「多模态备忘录」

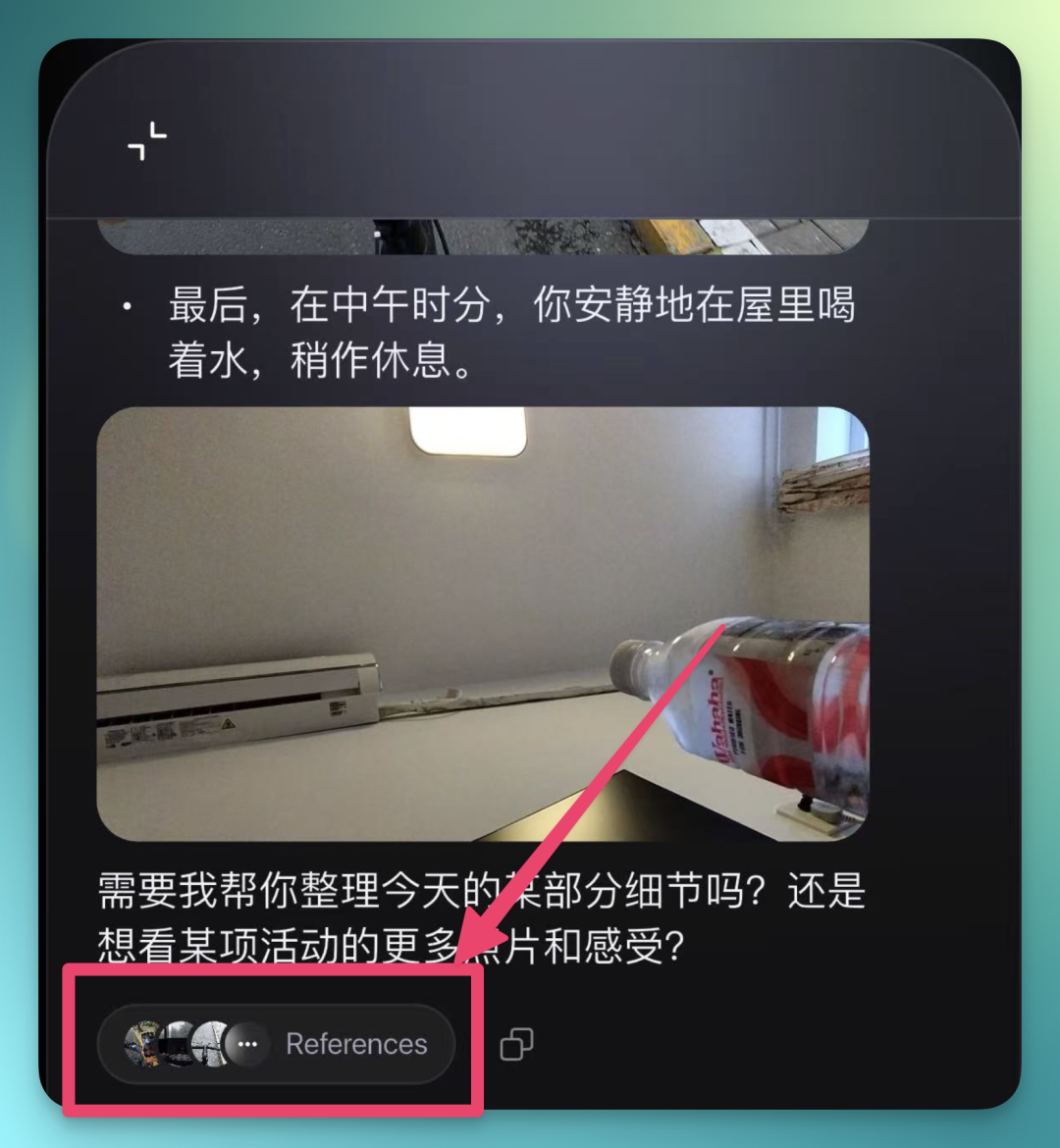

在 Chat 里,我发现 Looki 手机软件中的 AI 对于多模态内容的整理能力很不错,给我的实感是它就像一个 Agent,把所有的你的「Lifelog」,全都串联起来了!也因此,我发现了一些新的玩法。

比如说,我让它整理下:

我今天都做什么了

它居然会自动从「视频中挑选出最具有代表性的画面,并截图」,沿着时间线整理。

我觉得挺有意思的一个细节是,我在健身房锻炼时全程戴着 Looki L1,它把所有细节都识别出来了,给出的答案是:

到了健身房,做了力量训练和跑步机上的有氧活动,同时还看了会儿视频

这些内容都是通过 Looki 整理 8 月 16 日这一天的所有 Moment 中的多模态内容得出来的结果:

这种对于多模态能力的利用,就将「单纯记录」这个场景延伸得更远了。

比如,我问它(目前还只是比较基础的信息整理,据 Looki 团队,预计下个月能上线完整版):

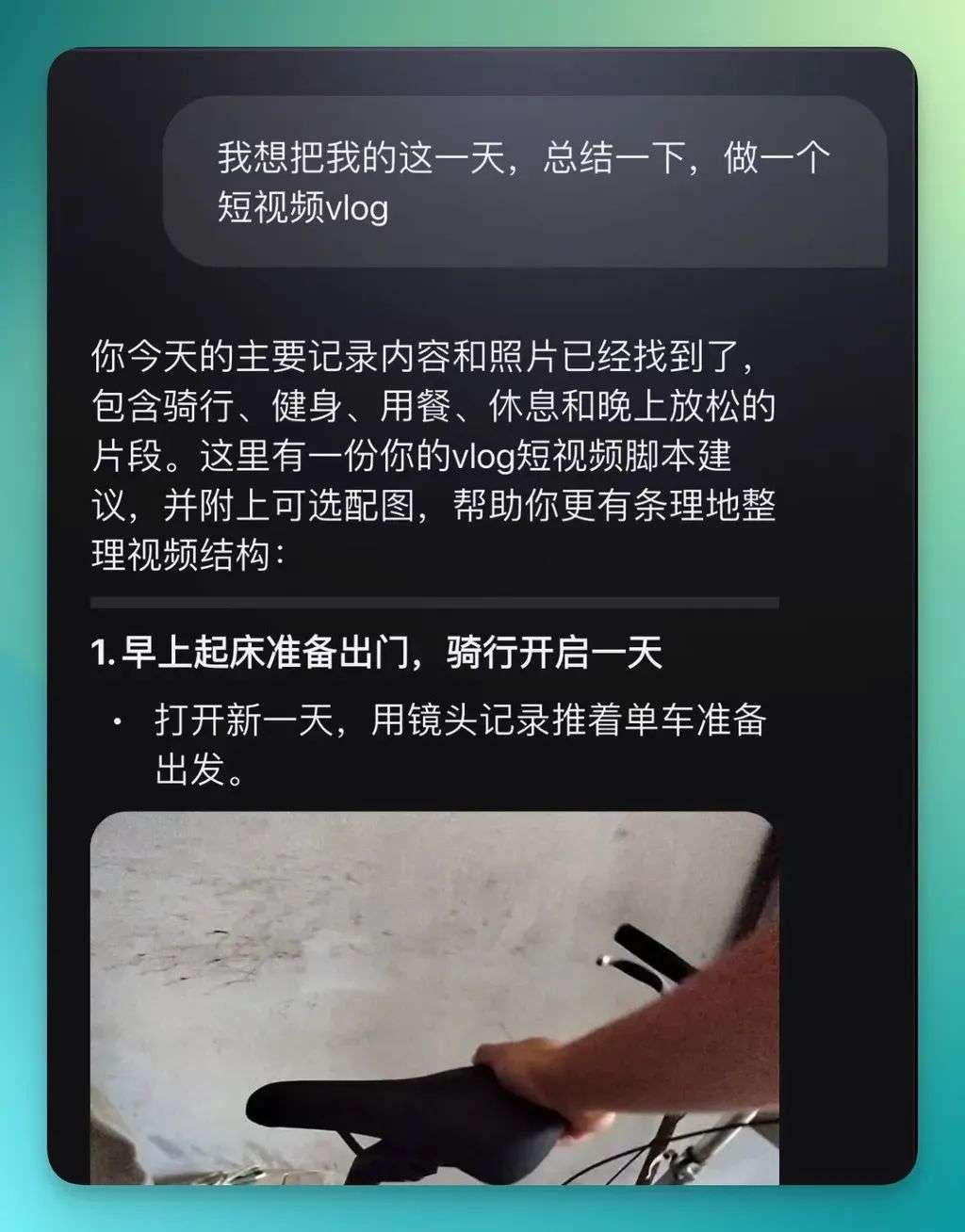

我想把我的这一天,总结一下,做一个短视频 vlog

然后上传额外的图片,让它:

将我上传的图片加入到 vlog 计划中

它能够将所有图片按照提示词整理:

现在,你想让 Looki 做到什么,都只缺一个有创意的 Prompt 了。

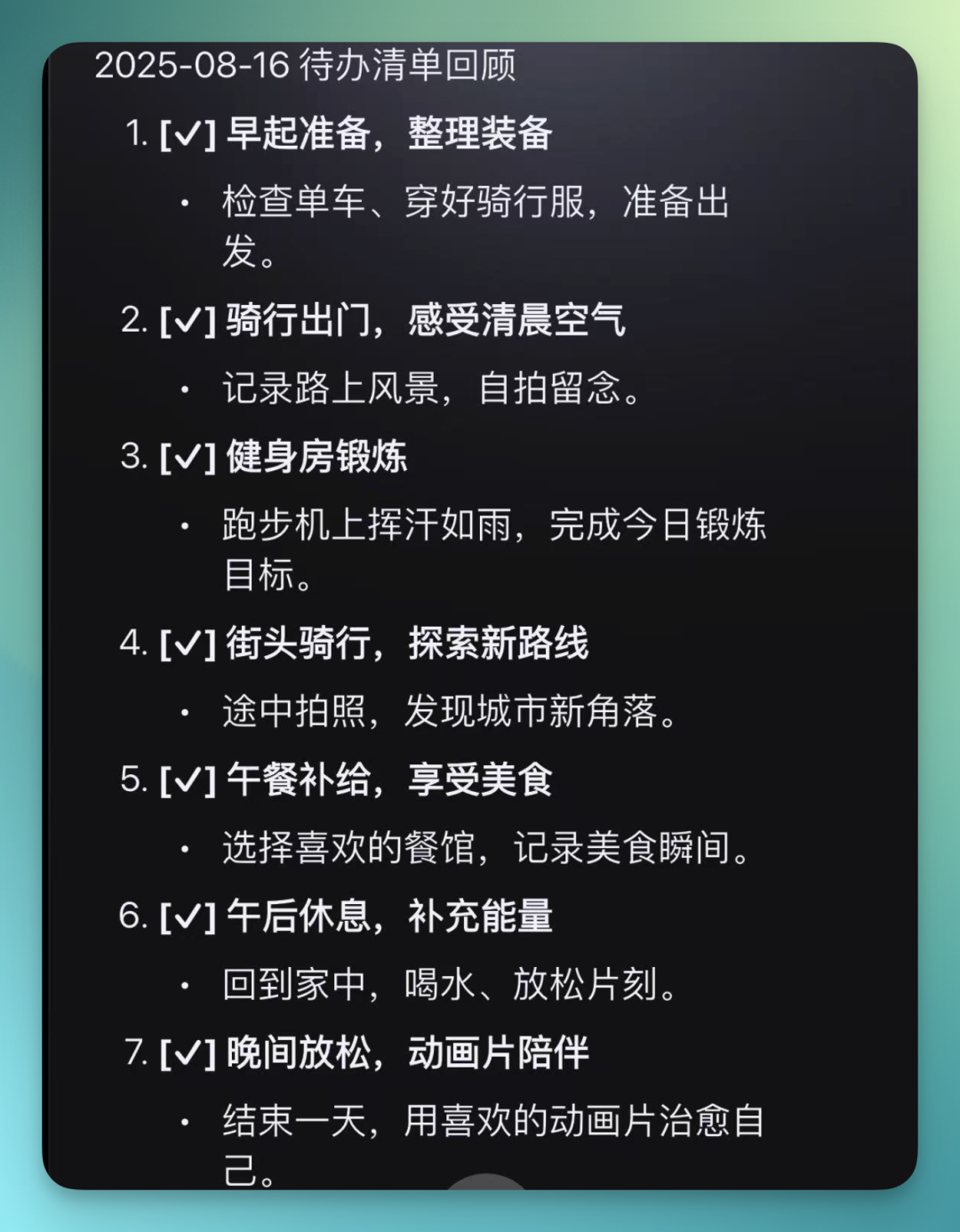

比如说,你可把你非常「努力的一天」当作一个模版,让它帮你:

把今天的片段整理成一份「待办清单回顾」,参考今天的日程,把它当作「明天的待办清单」,

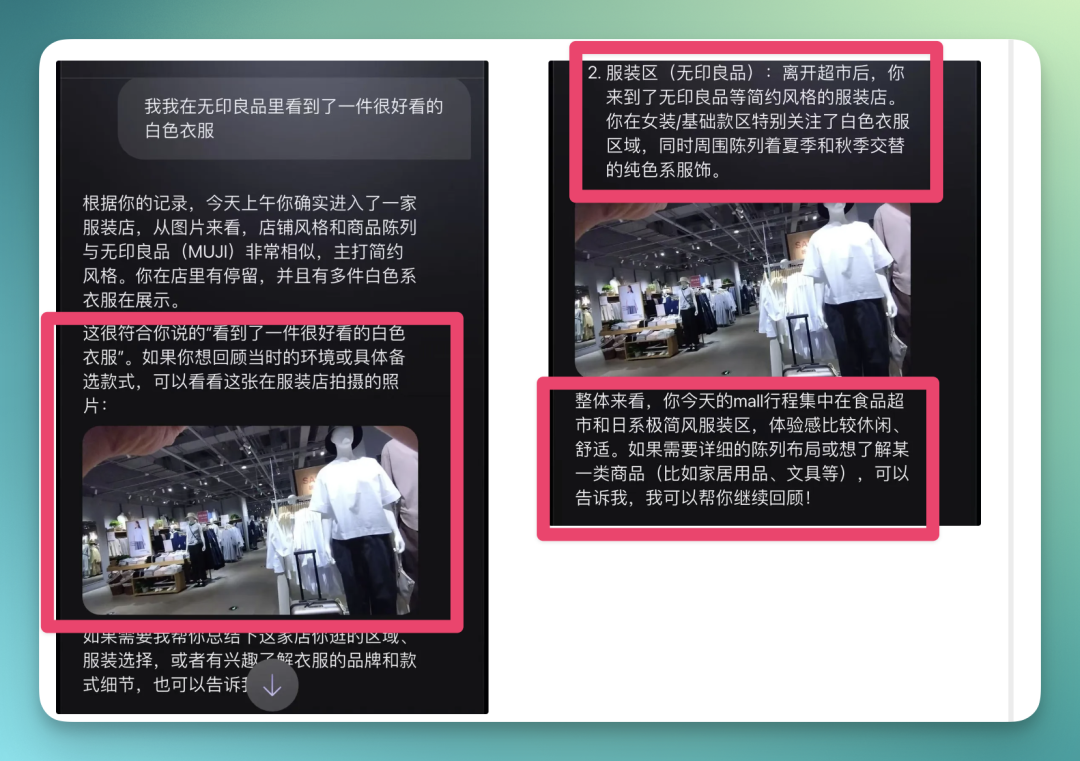

再比如,第二天我去随意逛了逛商场 Mall,我问它我曾在无印良品看到一件白衣服,在什么区域、长什么样?

Looki 甚至会根据拍摄到的「视频、图片」等信息判断布局,匹配上「无印良品」这家店,把当时的截图作为答案发出来。

还会在整体日程里,描述我去了「女装/基础款区」,还关注了夏秋纯色系衣服(关键是,我是真的在这一块区域转了转):

最后,在「For You」的 Tab 模块里,Looki 还会时不时的自动推送它 AutoCut(自动剪辑) 过的视频片段。这里,我推荐 @Tim Mack 的一段户外之旅:

除了视频功能之外,Looki 也支持录音、拍照等等功能,这些也都同样能构成 Looki 的「记忆库」。

最后,我们也想给 Looki 团队和用户双方提一些建议

在体验了几天之后,我对 Looki 依然充满期待,但也有一些想和团队交流的改进点。

1)地图联动

首先,我其实最期待的还是这些图片与「地图」功能联动,这样就会很轻松地整理出一次「远行」过程的每一个瞬间,可以把它分享到各种社媒平台。

比如我出去骑行或远行,Looki 在记录片段的同时,能自动把照片挂在地图路径上。晚上回顾时,就像在地图上“重走”了一遍旅程:

不过,现在的 Looki 暂时还没有接入「地图」,希望背后的技术团队多多「努力」(ps:文章发出前,Looki L1 团队给我们透露其即将上线地图功能)。

2)AI 自动剪辑

目前 Looki 偶尔会在 「For You 」 Tab 里推送一些自动拼接的视频,算是「彩蛋」式的体验。但这还不够。

真正实用的,应该是让用户能:主动选片 → 自动生成 vlog。

比如我今天跑了一次长途骑行,挑选几个片段,然后一键生成带音乐、转场的 1 分钟 vlog。这样不仅能满足记录和分享的需求,还能降低用户手动剪辑的门槛。

对很多人来说,AI 剪辑才是把「素材」变成「作品」的最后一环。请技术团队也多多考虑下除了「记录生活」之外的「分享生活」。

3)请「慢慢地用」

最后,我想说,Looki 最适合的使用方式,其实是「慢慢地用」。它并不是一个买来就能立刻「惊艳」的设备,而更像是一位需要时间陪伴的朋友。

因为只有当素材逐渐积累起来,Looki 的多模态 AI 才会真正显现出它的价值:

【1】它会越来越懂你常去的场景:每天骑行的路线、常坐的咖啡馆、下班后喜欢逛的那条街。

【2】它会逐渐捕捉到你的生活习惯与偏好。

【3】它甚至能帮你发现一些你自己都没注意到的「小规律」。

随着时间推移,这些零散的片段会被有机地整理在一起,慢慢织成一张关于我的生活网。那时,Looki 不只是一个记录工具,而会成为一份 「多模态备忘录」。所以,Looki 的魅力不在于「一时的新鲜感」,而在于它日复一日的陪伴。

最后,还有一个技术之外的挑战:

当 Looki L1 走出家门,它能否被社会所接纳?

Google Glass 的前车之鉴告诉我们,一个面向公众佩戴的拍摄设备,其设计不仅要考虑佩戴者的美学,更要考虑旁观者的感受。Looki L1 的极简设计和无声操作,在降低佩戴者存在感的同时,也让周围的人无法判断自己是否正在被记录,这可能会引发新的社交摩擦。

未来,这类设备或许需要一种新的「社交礼仪」。 比如一个清晰、公认的录制状态指示灯(目前的 Looki L1 的信任灯设计在一定程度上弥补了这种需求,但我们可能还需要更加「明显」的信号),或者一种在进入私人空间时自动休眠的机制。

一个产品能否融入社会,最终取决于它能否在「赋能个体」和「尊重公众」之间找到那个精妙的平衡点。

回归我们开头提出的悖论:如何记录生活而不打断生活?

Looki L1 的答案是,将记录的动作交给机器,把回味的权利还给人们。

经过多日实测,我们认为 Looki L1 的核心价值不在于硬件拍摄的便利,而在于其背后的大模型将海量、琐碎的日常片段,转化成一个可供检索、回溯、分析的「个人多模态数据库」。

你生活的海量细节,将真正为你所用,由你掌控。

文章来自于微信公众号“十字路口Crossing”,作者是“镜山”。

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0